Chiede come suicidarsi all’intelligenza artificiale e si toglie la vita, non sappiamo più ascoltare?

Giorni fa un ragazzo di 16 anni della California, Adam Raine, si è tolto la vita dopo aver passato mesi a confidarsi con ChatGPT, arrivando persino a chiedergli consigli su come impiccarsi. La sua famiglia ha denunciato OpenAI, accusando l’azienda di non aver fermato loro figlio. Quando si leggono queste storie, è naturale cercare un colpevole come la tecnologia, il chatbot, forse anche la scuola o i genitori. Ma la verità è che il problema non è ChatGPT in sé, né l’intelligenza artificiale in generale. Il problema è il contesto in cui Adam e tanti altri ragazzi si trovano: una società che spesso non li ascolta davvero, che non sa offrire spazi sicuri dove parlare delle proprie emozioni, delle proprie paure, delle proprie fragilità. I chatbot possono sembrare amici perfetti perché non giudicano, non interrompono, non si arrabbiano: ma alla fine… sono vuoti. Non possono sostituire il calore umano, la presenza reale, la possibilità di essere compresi da qualcuno che ti guarda negli occhi.

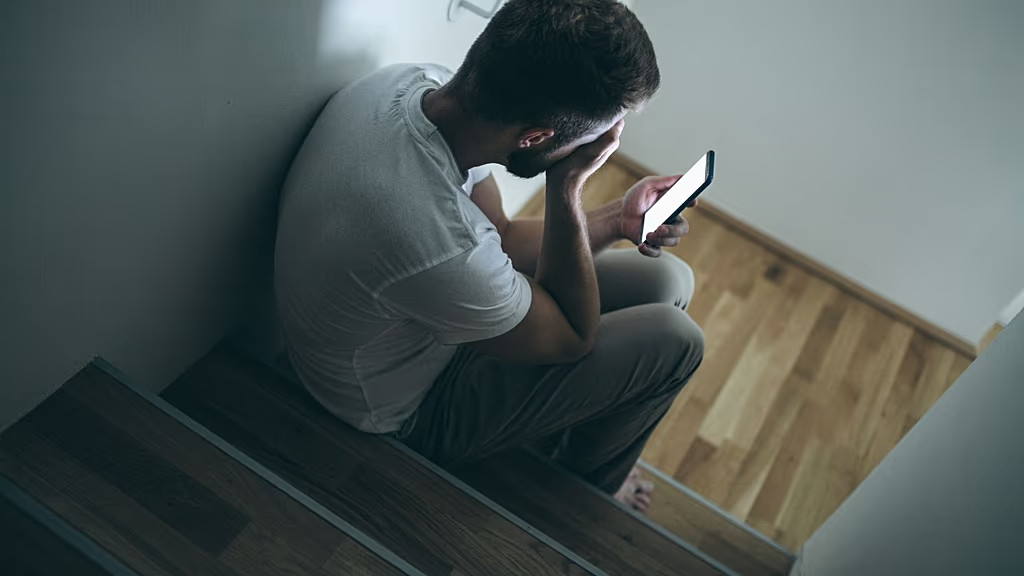

È comprensibile, che una persona sola, fragile, che desidera compagnia e amicizia, si “accontenti” anche di un’intelligenza artificiale. Quando mancano legami umani reali, un chatbot può sembrare davvero l’unico interlocutore pronto a rispondere senza giudizio, senza stanchezza, senza arrabbiarsi. Non è un capriccio, non è un “errore” è una risposta a un bisogno umano, quello di essere ascoltati. La differenza, purtroppo, è che un chatbot non può offrire empatia, presenza fisica o amore reale, elementi che in alcuni momenti possono davvero salvare una vita. Questa vicenda ci obbliga a riflettere sul modo in cui l’adolescenza oggi viene vissuta. Quasi tutti i ragazzi crescono circondati da schermi e notifiche, ma spesso, in realtà, sono soli. Parlano online con coetanei, sconosciuti trovati online o intelligenze artificiali, ma non trovano chi sappia fermarsi davvero ad ascoltarli. E quando arrivano i momenti più difficili, la mancanza di un adulto capace di dare attenzione, di dire “sto con te, ti ascolto” può fare la differenza tra la vita e la morte. Non si tratta di demonizzare la tecnologia, ma di capire i limiti di affidarsi a strumenti artificiali quando ciò che serve davvero è relazione, empatia, presenza reale, persone reali.

OpenAI ha introdotto filtri, controlli, sistemi di segnalazione, ma non sono perfetti, e la lunga esposizione a un chatbot può portare a situazioni impreviste. Questa realtà mostra che servono regole più chiare, strumenti di sicurezza più efficaci e un’attenzione costante ai segnali di rischio, soprattutto per chi è giovane e vulnerabile. Ma non basta la tecnologia: servono famiglie, insegnanti, amici e comunità pronti a dare ascolto prima che sia troppo tardi.

Guardare a questa tragedia significa fare un passo indietro e chiederci: stiamo davvero ascoltando i ragazzi? Stiamo davvero offrendo loro spazi dove sentirsi sicuri, senza giudizio, senza paura di essere ignorati? Oppure li lasciamo soli davanti a schermi che, per quanto intelligenti, non possono rispondere a quello che serve davvero? La tecnologia può aiutare, può accompagnare, può essere uno strumento utile, ma non può sostituire le relazioni umane, e non può sostituire l’empatia.